周六下午和爱人一起去了天目里,散步、聊天、看风景、喝茉酸奶、吃烧鸟、去鸟屋书店读书、去饸饹面馆吃面。这是我们第二次去这里了,主要是那家面馆的面很符合我们口味,但也不能打车过去就吃个面,所以每次都要看一两个小时书。这本书就是这天我读的两本书之一,还剩最后一章没读完,我觉得问题不大,得赶紧把读过的记下来。

基础和取舍

没想到居然一年多没写这样思考性的文字了,ChatGPT后遗症有点大。去年底换工作再加上孩子出生,生活一下子变得异常充实了起来。家庭和育儿方面成长很多,从一开始的没耐心,到逐步理解包容、感同身受(无论对爱人还是孩子),一年不到时间改变了非常多。工作方面也取得了一些成果,强度和深度比此前所有工作都高了一个级别,虽然很忙,但非常开心。比较不满意的是过于忙碌导致没时间夯实基础,总感觉自己比较浮。正好国庆假期,重新整理一下思路。

MIO

Tiny LLM Continual Pre-training:RHO-1

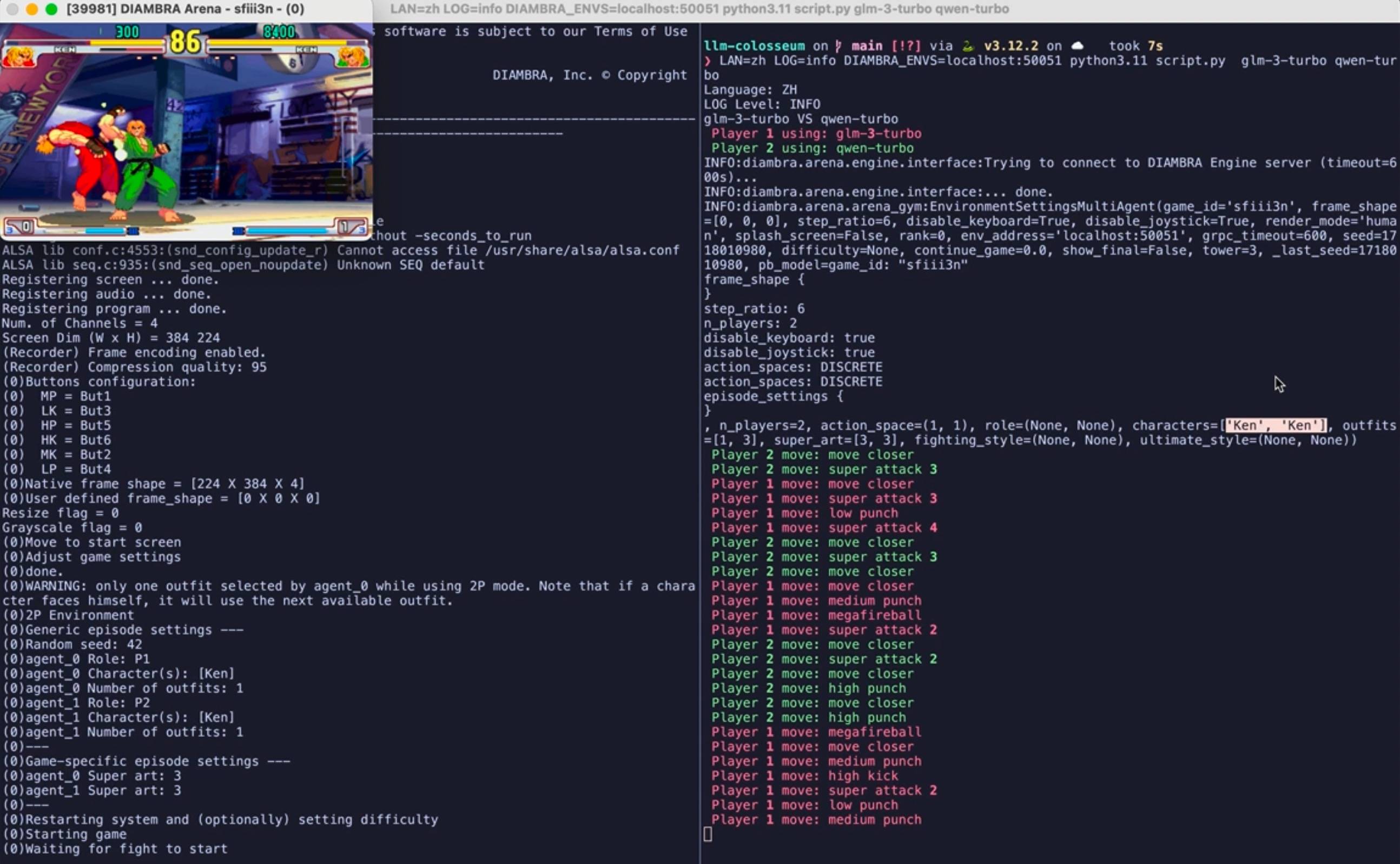

LLM打街霸

国外的一个项目,看了一下比较简单,于是也拿过来玩儿一下。由于原项目没支持中文,就简单支持了一下,顺便简单地重构了一下代码。

- 代码地址(Fork):https://github.com/hscspring/llm-colosseum

- 项目原地址:https://github.com/OpenGenerativeAI/llm-colosseum

LLM中的演绎推理、归纳推理和溯因推理

LLM极简科普

编者按:本文内容来自Datawhale《AI第一课》,目标是向普通大众传播AI相关知识。本文是第一稿,太过于偏技术,因此需要重新修改打磨。不过从有编程背景读者的角度看我觉得内容尚可,特记录在此。同时也是便于后面对比最终内容和最初内容的差别,提升自己科普内容创作方面的技巧。

简介

本节主要介绍LLM(Large Language Model,大语言模型)的基础科普。大纲如下:

- 计算机如何识别文字:Token化+词嵌入(Tokenize+Embedding)

- 大模型如何学习(训练):下个词预测(Next Token Prediction,NTP)

- 大模型如何理解文本:多层多头注意力(Multi-Layer+Multi-Head Self-Attention,MHA)

- 大模型如何处理任务:上下文学习或情境学习(In-Context Learning)

- 大模型如何生成回复:推理(Inference)

本文涉及到上面提到的重要概念时,会以中文表述,括号内的是对应的英文表达。

Programming Language Environment Cheat Sheet

编程语言环境相关备忘(我只想复制粘贴)。

LLM Tiny Pretrain:H2O-Danube and Stable LM

StableLM 一直致力于小模型(从7B、3B 到 1.6B),不过 License 商用有些限制,H2O-Danube 是 Apache2.0 的小模型(1.8B),整体指标略逊于 StableLM。本文通过这两篇 Paper,记录小模型的预训练。