今天介绍一篇 Agentic RL 相关的比较巧妙的论文:2605 GAGPO: Generalized Advantage Grouped Policy Optimization[1],如果用一句话简要概括,那就是:“用 GROUP 的方法计算 V”,效果不错,以至于当时看了第一反应是怀疑。不过仔细阅读全文后,发现确实很有意思,而且实验也比较全面。

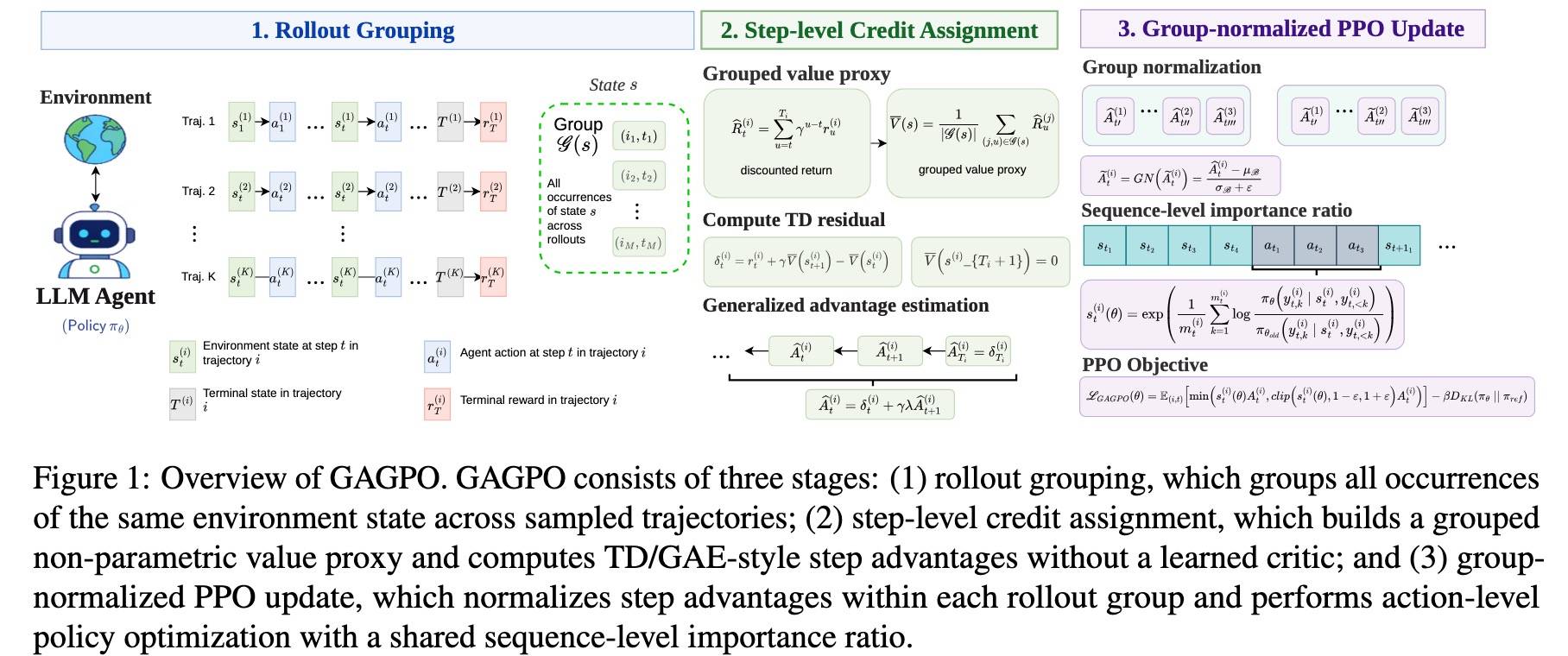

它的出发点很简单——不要 Value 模型,怎么把后续结果有效地回传到每个中间步骤。本文提出的 GAGPO = Generalized Advantage Grouped Policy Optimization,它是一种无需 Critic 的 RL 算法,能够实现精确的、与步骤对齐的时序 credit assignment。

做法更加简单——从采样得到的 rollout 中构建一个非参数化的分组价值代理,然后通过 TD/GAE 把最终结果的监督信号沿时间维度传播到前面的每一步(注意是 Step,不是 Token)。

这里的关键就是第二步——用 GRPO GROUP 的方法计算 V,然后用 GAE 的方法计算每一步的 A(注意,每个 Step 的所有 Token 的 A 一样)。而这一步的关键是 Agentic 任务相对稳定的 State。